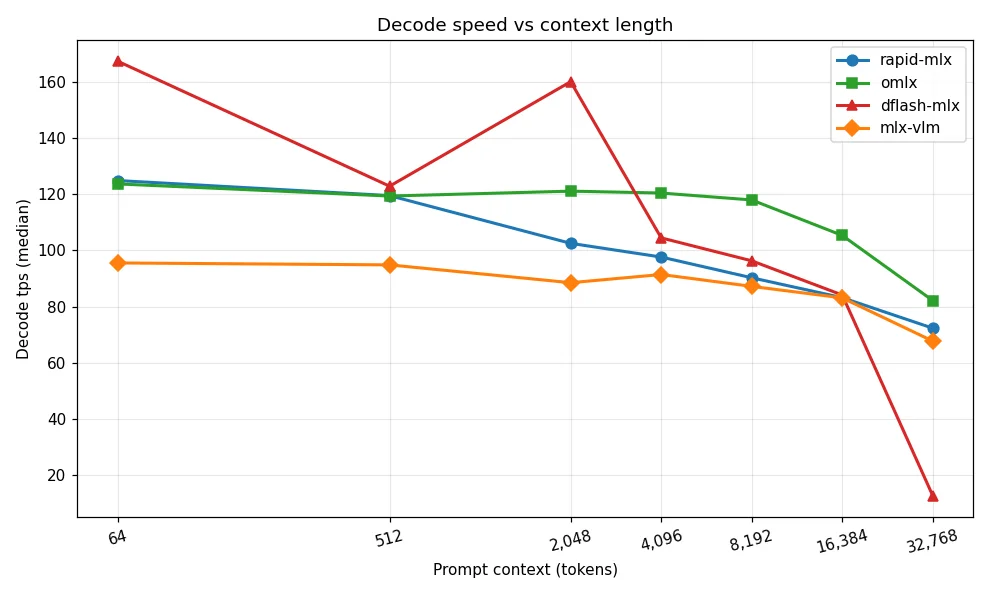

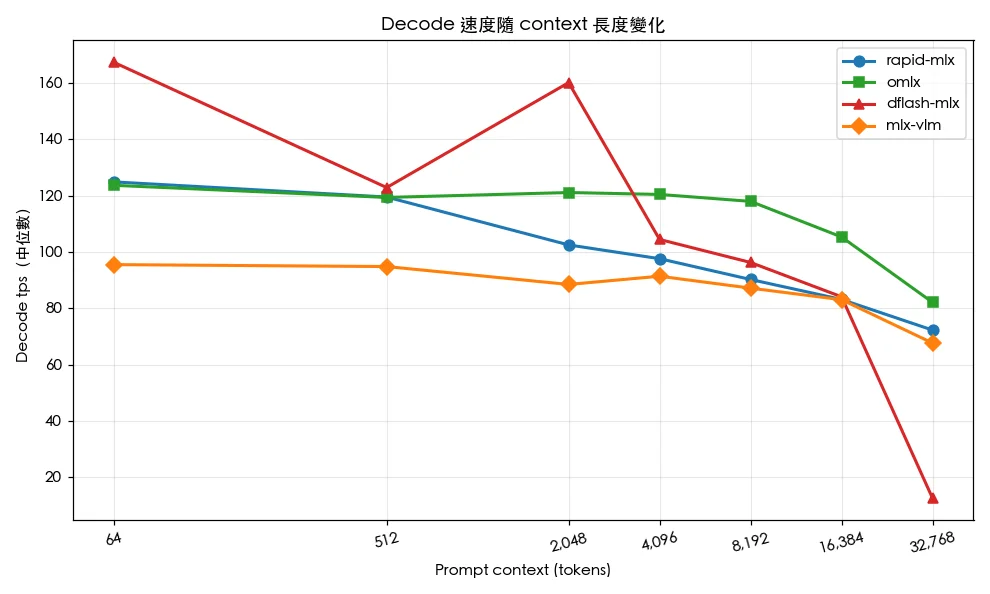

MLX 推論框架基準測試:Apple Silicon M5 Max 跑 35B LLM 實測比較

在 Apple M5 Max(64 GB 統一記憶體)上以 35B 量化 MoE 模型實測 rapid-mlx、omlx、dflash-mlx、mlx-vlm 四大 MLX 推論框架,涵蓋 64 至 32K Tokens 七個上下文長度的解碼速度、TTFT 與穩定度比較,並提供企業地端 AI 選型建議。原始基準測試資料由 ywchiu/mlx_benchmark_lab 開源公開。

閱讀更多